はじめに

- Raspberry Pi 2が余ってたので、Minecraft(マイクラ)ホームサーバーを作ってみた。

- ヘビーユーザーではないので、Raspberry Pi 2でも快適でした。

- makecodeでMinecraftのプログラミングすると面白ですよ。

作り方

- ここを参考にしました。

- 環境の更新を確認

sudo apt update sudo apt upgrade

- raspi-configでOverclockなど各種設定を行う

sudo raspi-config ->Advanced Options > Memory Split > 16MB ->Boot Options > Desktop/CLI > Console ->Overclock > High ->Advanced Options > SSH ->Advanced > Expand Filesystem

- nukkitサーバー(マイクラサーバー)をinstallする

sudo apt install oracle-java8-jdk mkdir nukkit cd nukkit wget -O nukkit.jar https://ci.nukkitx.com/job/NukkitX/job/Nukkit/job/master/lastSuccessfulBuild/artifact/target/nukkit-1.0-SNAPSHOT.jar

- nukkitサーバー(マイクラサーバー)を実行する

cd nukkit sudo java -jar nukkit.jar

- nukkitサーバー(マイクラサーバー)の設定を変更する

https://sp.ch.nicovideo.jp/komnazsk/blomaga/ar1675635sp.ch.nicovideo.jp

sudo nano server.properties -> max-players=5

- nukkitサーバーのpluginをダウンロードしてインストールする

cd nukkit sudo mv MobPlugin-1.9.0.1.jar plugins

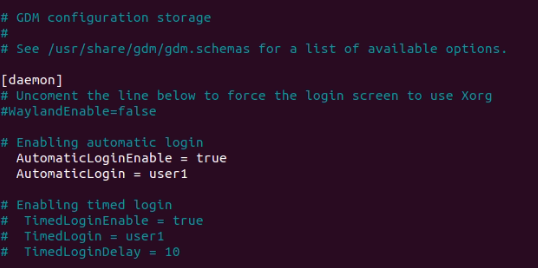

ラズパイ起動時にnukkitサーバー(マイクラサーバー)を自動起動する

- run_nukkit_server.shを作る

cd nukkit nano run_nukkit_server.sh

- run_nukkit_server.shの記述内容

#!/bin/bash #run_nukkit_server.sh ### run server cd home/hoge/nukkit/ sudo java -jar nukkit.jar

- /etc/rc.localにrun_nukkit_server.shを追記する

cd /usr/local/bin ln -s home/hoge/nukkit/run_nukkit_server.sh sudo nano /etc/rc.local

- /etc/rc.localの書き方.exit 0の前に.sh名を記載(root権限で実行される)

run_nukkit_server.sh exit 0

- 最後リブートしてrun_nukkit_server.shが起動しているか確認

sudo reboot ...(wait...) ps aux | grep run_nukkit_server.sh

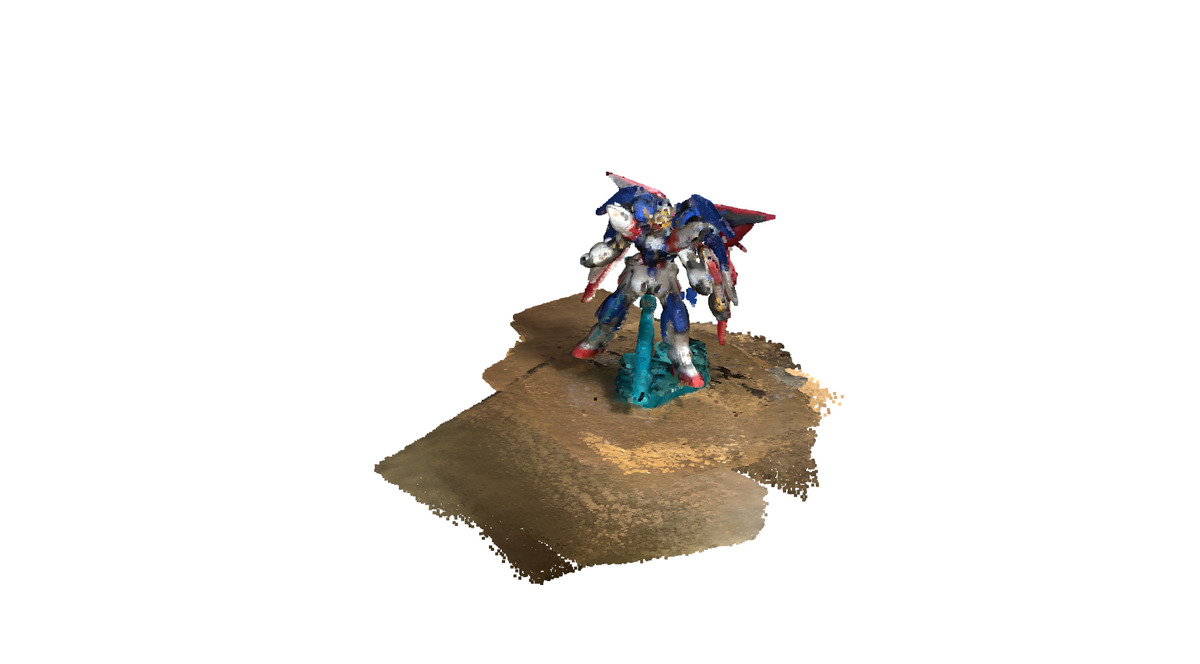

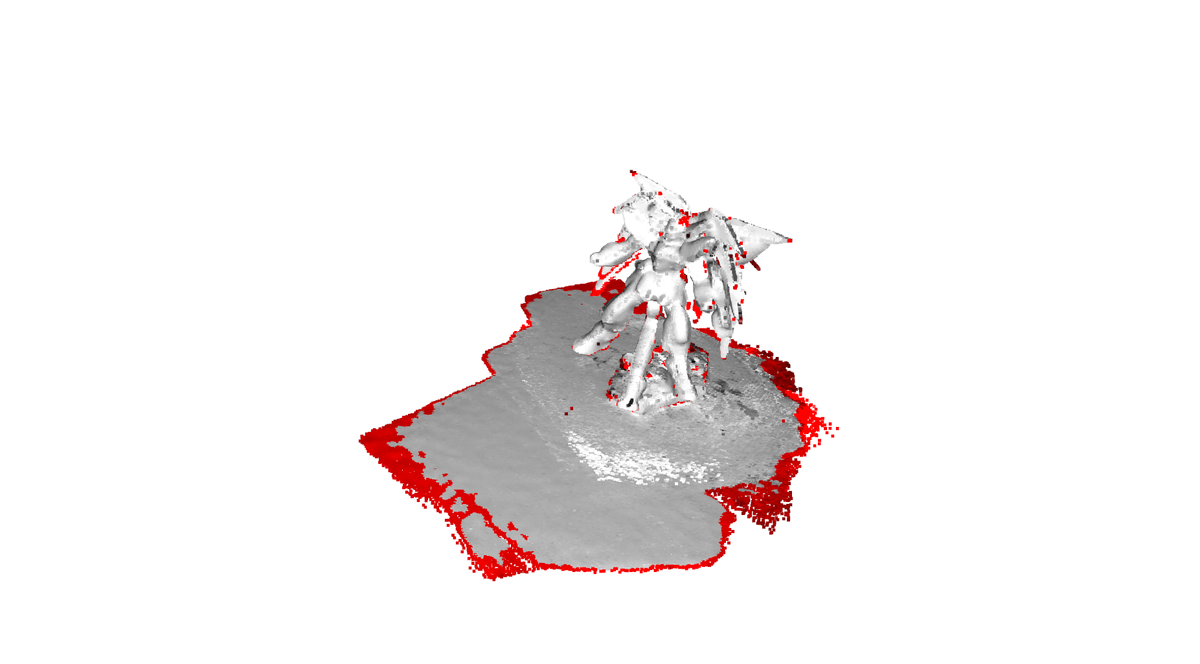

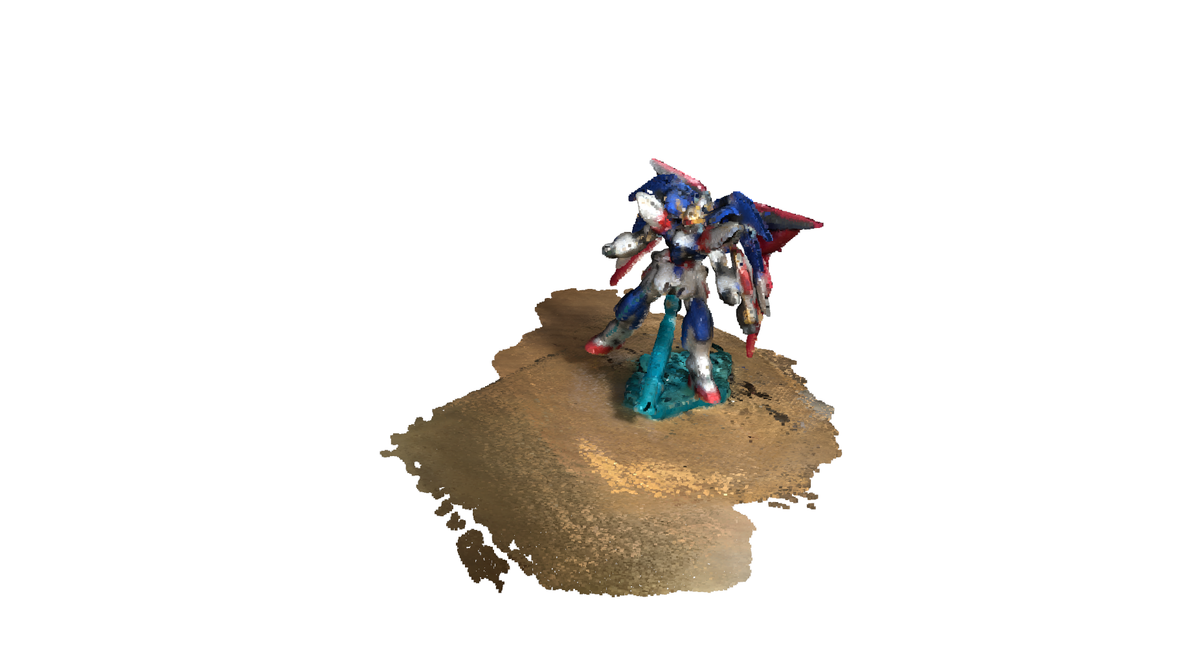

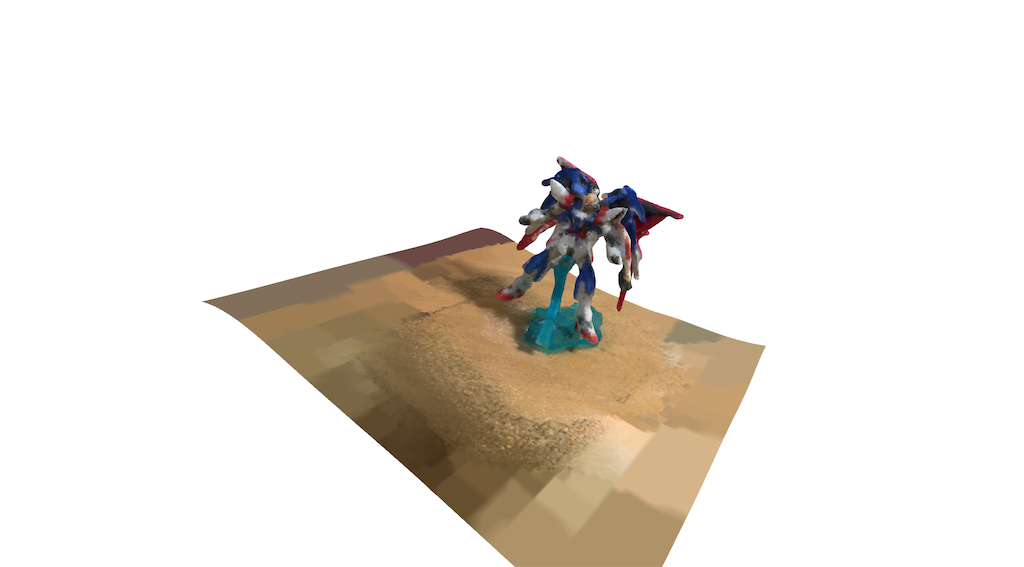

動きました(iphoneでサーバーに入った様子)

快適な自宅マイクラサーバーライフを。